Deep Learning vs. Machine Learning: A Diferença que Pode Custar Milhões ao Seu Negócio

Deep Learning vs. Machine Learning: A Diferença que Pode Custar Milhões ao Seu Negócio

Imagine a cena: uma equipe de desenvolvimento, empolgada com a promessa da IA, investe seis meses e um orçamento considerável em um projeto de Deep Learning. O objetivo? Criar um sistema de recomendação hiperpersonalizado para um e-commerce de médio porte.

O problema? O volume de dados da empresa era modesto e a complexidade do problema não justificava uma solução tão robusta. No final, um modelo simples de Machine Learning supervisionado, treinado em semanas, teria entregue 95% do resultado com 10% do custo e da complexidade.

Esta não é uma história fictícia. A confusão entre Machine Learning (ML) e Deep Learning (DL) vai muito além da semântica – é uma decisão estratégica que impacta orçamentos, prazos e, em última análise, o sucesso ou fracasso da sua iniciativa em Inteligência Artificial.

Vamos desmistificar esses conceitos de uma vez por todas.

O Que é Machine Learning? O Algoritmo que Aprende Sozinho

Esqueça definições complexas. Pense no Machine Learning como um assistente extremamente eficiente, mas que precisa de um manual de instruções claro.

Você fornece a ele exemplos passados (os dados) e especifica exatamente o que deseja que ele aprenda a prever (o label ou resultado). Ele encontra os padrões sozinhos e, a partir daí, consegue fazer previsões sobre novas informações.

Definição e Conceito Central

Machine Learning é um subcampo da Inteligência Artificial (IA) focado em criar sistemas que aprendem e melhoram com a experiência, sem serem explicitamente programados para cada tarefa.

A palavra-chave aqui é "aprender". Em vez de regras fixas escritas por um humano, o modelo descobre suas próprias regras a partir dos dados.

Como Funciona o Processo de Aprendizado de Máquina

O fluxo segue estas etapas principais:

1. Coleta de Dados: Reúne-se informação histórica relevante.

2. Pré-processamento e Feature Engineering: Aqui está grande parte do trabalho humano. É necessário limpar os dados e, principalmente, escolher e criar manualmente as features (características) que o modelo usará para aprender. Por exemplo: para prever inadimplência, você criaria features como "score de crédito", "renda mensal" e "número de parcelas em aberto".

3. Escolha do Algoritmo: Árvores de Decisão, SVM, Regressão Logística. São as ferramentas disponíveis.

4. Treinamento: O algoritmo "consome" os dados com suas features e ajusta seus parâmetros internos.

5. Avaliação e Implantação: O modelo é testado com dados novos e, se o desempenho for satisfatório, é colocado em produção.

Principais Tipos de Aprendizado

- Supervisionado: O mais comum. Você tem dados de entrada e a resposta correta (o label). O modelo aprende o mapeamento entre um e outro. É usado para classificação (spam/não spam) e regressão (prever um valor numérico).

- Não Supervisionado: Os dados não têm label. O objetivo é encontrar estruturas ou agrupamentos ocultos. Ideal para segmentação de clientes ou detecção de anomalias.

- Por Reforço: O modelo aprende por tentativa e erro, recebendo recompensas ou penalidades por suas ações. É a base de muitos bots de jogos e está por trás de otimizações complexas.

Exemplos Práticos de Machine Learning no Dia a Dia

O ML está presente em diversas aplicações cotidianas:

* O filtro de spam do seu e-mail.

* O sistema de recomendação da Netflix (que sugere filmes com base no seu histórico e no de usuários similares).

* A análise de risco de crédito ao solicitar um empréstimo.

* A detecção de transações fraudulentas no seu cartão.

São problemas onde as features são relativamente claras e estruturadas.

O Que é Deep Learning? A Potência das Redes Neurais Profundas

Agora, imagine um problema tão complexo que nem mesmo um especialista humano consegue definir bem as features. Como ensinar um computador a reconhecer um gato em uma foto? Listar "bigodes", "olhos amendoados" e "pelagem" é insuficiente e subjetivo.

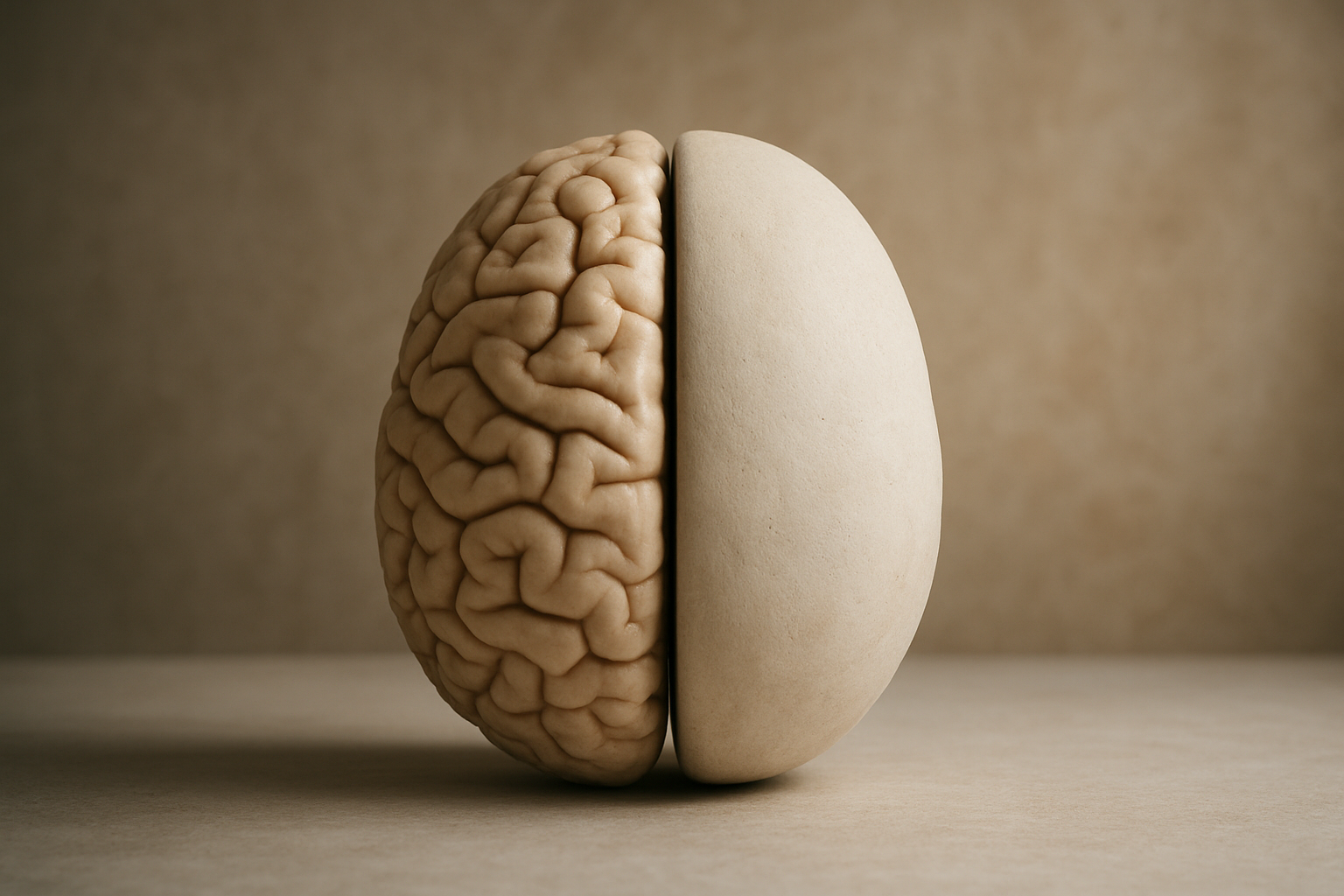

É aí que entra o Deep Learning. Ele não precisa desse manual de instruções detalhado. Ele cria suas próprias features, de baixo nível até as mais abstratas, por meio de uma arquitetura inspirada (de forma livre) no cérebro humano: as redes neurais profundas.

Uma Subárea Avançada do Machine Learning

Este ponto é crucial: Todo Deep Learning é Machine Learning, mas nem todo Machine Learning é Deep Learning. O DL é uma evolução dentro do campo do ML, especializada em resolver problemas de extrema complexidade usando Redes Neurais Artificiais (RNAs) com muitas camadas.

A Arquitetura das Redes Neurais Artificiais (RNAs)

Pense em uma rede neural como uma série de camadas de "neurônios" artificiais conectados.

* Camada de Entrada: Recebe os dados brutos (pixels de uma imagem, palavras de um texto).

* Camadas Ocultas: É aqui que a profundidade (deep) acontece. Pode haver dezenas ou centenas de camadas. Cada uma aprende a identificar features cada vez mais complexas.

* Camada de Saída: Produz o resultado final (ex.: "gato" com 98% de certeza).

O processo de backpropagation é o que ajusta os "pesos" das conexões entre neurônios, minimizando o erro – é o "treino".

O Papel Crucial das Camadas Ocultas e do "Aprendizado Profundo"

Na primeira camada oculta, os neurônios podem aprender a detectar bordas simples.

Na segunda, combinam bordas para formar formas básicas (círculos, retângulos).

Na décima, podem estar identificando "olhos" ou "nariz".

Na camada final, a combinação dessas features de alto nível resulta em "rosto de gato".

Essa hierarquia automática de features é o superpoder do DL.

Por Que o Deep Learning Precisa de Big Data e GPUs?

Essa arquitetura complexa tem um preço: fome de dados. Para aprender tantos parâmetros sozinho, o DL precisa de milhões de exemplos. Além disso, o treinamento é computacionalmente muito custoso.

É por isso que o DL explodiu junto com a era do Big Data e das GPUs (Unidades de Processamento Gráfico). Essas placas, originalmente criadas para jogos, são ideais para os cálculos paralelos massivos que as redes neurais demandam. Sem essa combinação, o DL permaneceria uma curiosidade acadêmica.

Comparação Direta: Machine Learning vs. Deep Learning

Vamos colocar lado a lado. A tabela abaixo sintetiza o cerne da questão:

| Característica | Machine Learning (Tradicional) | Deep Learning |

|---|---|---|

| Volume de Dados | Funciona bem com volumes menores a moderados. | Requer Big Data (milhões de exemplos). |

| Feature Engineering | Manual e crucial. O sucesso depende da expertise humana para criar features. | Automático. As redes neurais extraem features hierárquicas dos dados brutos. |

| Complexidade do Problema | Ideal para problemas com features bem definidas e estruturadas (tabelas, dados numéricos/categóricos). | Brilha em problemas de alta complexidade e percepção: imagem, vídeo, áudio, texto natural. |

| Interpretabilidade | Relativamente mais interpretável. É possível entender a importância de cada feature. | Caixa-preta complexa. É difícil entender exatamente como a rede chegou a uma decisão. |

| Requisitos Computacionais | Moderados. Pode rodar em CPUs comuns para muitos casos. | Extremamente altos. Requer GPUs poderosas e/ou muito tempo de treinamento. |

| Custo de Implementação | Geralmente menor. Foco no talento humano para análise e engenharia de features. | Geralmente muito alto. Custos com infraestrutura (cloud GPUs) e dados são significativos. |

Fluxo de Trabalho: Do Feature Engineering à Extração Automática

Essa é a diferença prática mais impactante. No ML, o cientista de dados passa a maior parte do tempo no pré-processamento e na criação criativa de features. É um trabalho artesanal.

No DL, essa etapa é internalizada pela rede. O engenheiro foca mais na arquitetura da rede, no ajuste de hiperparâmetros e, claro, em garantir uma grande quantidade de dados de qualidade.

Desempenho e Precisão em Diferentes Cenários

Com dados suficientes e problemas complexos, o DL quase sempre supera o ML tradicional. A precisão em tarefas como reconhecimento de fala ou tradução automática deu um salto com o DL.

No entanto, para muitos problemas de negócio com dados tabulares (como previsão de churn ou análise de risco), algoritmos clássicos de ML como Gradient Boosting (XGBoost, LightGBM) ainda são estado da arte e muito mais eficientes.

Usar DL nesses casos é como usar uma escavadeira para plantar um vaso de flor.

Estudo de Caso: Reconhecimento de Imagens na Prática

Vamos tornar isso concreto com um exemplo que mudou o jogo.

O Desafio: Ensinar um Computador a Identificar um Gato

A tarefa parece simples para um humano, mas era um grande desafio para a computação até pouco tempo atrás.

A Abordagem com Machine Learning Tradicional

- Uma equipe de especialistas em visão computacional passaria meses definindo manualmente um conjunto de features para extrair das imagens: histogramas de cor, texturas, detectores de borda (Canny, Sobel), descritores como SIFT ou SURF.

- Essas features extraídas seriam usadas para treinar um classificador, como uma SVM (Máquina de Vetores de Suporte).

- O resultado? Um sistema frágil, com desempenho medíocre (acurácia na casa dos 70-80%), que funcionava mal com variações de iluminação, ângulo ou raça do gato. Qualquer mudança no cenário exigia reengenharia das features.

Era caro, lento e limitado.

A Revolução com Deep Learning e Redes Convolucionais (CNNs)

Em 2012, a rede neural AlexNet, uma CNN (Rede Neural Convolucional), venceu uma competição de reconhecimento de imagem com uma margem de vantagem impressionante.

Como funcionou?

* A rede recebeu os pixels brutos de milhões de imagens rotuladas.

* As camadas convolucionais iniciais aprenderam automaticamente a detectar bordas e texturas.

* Camadas mais profundas combinaram essas bordas em formas, depois em partes de objetos (olhos, orelhas, patas), e finalmente no conceito de "gato".

* O treinamento, feito em GPUs, ajustou centenas de milhões de parâmetros.

Resultados Comparativos e Lições Aprendidas

A acurácia saltou para níveis super-humanos (>95%). O sistema se tornou robusto a variações. E o mais importante: o mesmo princípio arquitetural (CNNs) passou a ser aplicado a milhares de outros problemas de visão, sem a necessidade de redesenhar features do zero para cada um.

A lição? Para problemas de percepção pura, onde a feature é a própria matéria-prima (pixels, ondas sonoras), o DL é uma mudança de paradigma.

Aplicações no Mundo Real: Onde Cada Tecnologia Brilha

Vamos mapear o território. Saber onde cada uma se destaca evita escolhas erradas.

Machine Learning em Ação

- Sistemas de Recomendação (não apenas por imagem): A recomendação "clientes que compraram X também compraram Y" do e-commerce é puro ML colaborativo.

- Previsão de Demanda e Logística: Algoritmos preveem vendas sazonais para otimizar estoque.

- Manutenção Preditiva em Indústrias: Analisa dados de sensores (vibração, temperatura) para prever falhas em máquinas.

- Detecção de Fraudes Financeiras: Identifica padrões anômalos em transações.

- Análise de Sentimento em Redes Sociais: Classifica textos como positivo, negativo ou neutro (embora o DL esteja avançando aqui também).

Deep Learning Dominando

- Carros Autônomos: As CNNs processam o fluxo de câmeras, lidar e radar em tempo real para identificar pedestres, placas e outros carros.

- Assistentes de Voz (Siri, Alexa, Google Assistant): Redes neurais recorrentes (RNNs) e Transformers convertem fala em texto e entendem a intenção do comando.

- Diagnóstico Médico por Imagem: CNNs ajudam radiologistas a detectar câncer, fraturas ou anomalias em exames de raio-X, ressonância e tomografia com alta precisão.

- Tradução Automática (Google Translate): Modelos baseados em Transformers traduzem entre idiomas com fluência impressionante.

- Geração de Imagens e Texto (IA Generativa): Modelos como DALL-E e GPT são baseados em arquiteturas de DL massivas.

Casos de Uso Híbridos e a Convergência das Tecnologias

A fronteira não é rígida. Muitas soluções modernas usam o melhor dos dois mundos.

Um sistema de Processamento de Linguagem Natural (NLP) pode usar embeddings do Word2Vec (técnica de DL) para representar palavras e depois alimentar um classificador mais simples de ML para uma tarefa específica, como categorizar tickets de suporte.

A convergência é a regra, não a exceção.

Limitações e Desafios de Cada Abordagem

Nenhuma tecnologia é uma bala de prata. Ignorar os contras é um erro estratégico.

Os Riscos do Machine Learning: Viés em Dados e Modelos "Caixa-Preta" Simples

O ML herda os vieses presentes nos dados históricos. Se os dados de contratação de uma empresa são enviesados contra um gênero, o modelo de triagem de currículos aprenderá e perpetuará esse viés.

Além disso, modelos complexos como ensembles podem ser difíceis de interpretar, criando um problema de confiança e governança. A explicabilidade da IA (XAI) se tornou um campo vital justamente por isso.

Os Desafios do Deep Learning: Fome por Dados, Custos e Caixa-Preta Complexa

A fome por dados é a maior barreira para a adoção em muitas empresas. Sem um dataset grande e bem rotulado, o DL simplesmente não decola.

Os custos são proibitivos. Treinar modelos de última geração requer farms de GPUs ou contas em nuvem que podem chegar a dezenas de milhares de dólares. Para uma PME, isso é um impeditivo real.

Por fim, a caixa-preta é ainda mais complexa. Entender por que uma rede neural diagnosticou um tumor é um desafio de pesquisa ativo. Em setores regulados como saúde e justiça, isso é um obstáculo sério.

Considerações Éticas e a Importância do Monitoramento Contínuo

Independentemente da técnica, a IA não é "implantar e esquecer". Modelos sofrem desgaste conceitual (concept drift) – o mundo muda e o modelo fica desatualizado. Um monitoramento contínuo do desempenho, a auditoria para vieses e um framework ético sólido não são opcionais; são fundamentais para uma IA responsável e sustentável.

Conclusão: Como Escolher a Abordagem Certa para o Seu Negócio

A escolha entre Machine Learning e Deep Learning não é sobre qual tecnologia é "melhor". É sobre qual é a mais adequada para o seu problema específico, contexto e recursos.

Faça estas perguntas antes de decidir:

- Qual a natureza e complexidade do meu problema? (Dados tabulares vs. imagem/áudio/texto)

- Qual o volume e qualidade dos meus dados? (Temos "Big Data" rotulado?)

- Qual o meu orçamento e expertise técnica? (Temos acesso a GPUs e especialistas em DL?)

- A interpretabilidade do modelo é crítica? (Setor regulado, necessidade de transparência)

Comece sempre pela solução mais simples. Um projeto de